Pour sa rentrée et sa huitième édition, le Signal et le Bruit ce sont 1240 mots, 6 recommandations de lecture et 1 cartographie. Nous tentons de faire le point sur les capacités actuelles et projetées de l’intelligence artificielle en nous appuyant sur les travaux du chercheur Nick Bostrom et des équipes de recherche des laboratoires OpenAI et DeepMind. Notre prochain envoi sera plus prospectif et cherchera à cartographier les grandes controverses autour des promesses et des risques présumés des superintelligences—sans citer Skynet.

Dans les publications scientifiques, les œuvres de fictions et les discours commerciaux, tout comme dans les colonnes de cette newsletter, l’intelligence artificielle est un concept largement manipulé mais souvent peu explicité. Défini comme “l'ensemble des théories et des techniques mises en œuvre en vue de réaliser des machines capables de simuler l'intelligence”, il est compliqué d’en dessiner des contours plus précis, tant l’IA recouvre des réalités techniques et des niveaux “d’intelligence” très disparates—et souvent difficiles à identifier sous le vernis marketing.

Si le mot tend à devenir un “signifiant vide”, ou à être utilisé comme un simple synonyme de certaines des briques techniques qui le composent, il est cependant difficile de nier que les avancées des dix dernières années représentent un véritable bond en avant. Par opposition aux IAs antérieures aux années 2000, qui étaient principalement des machines programmées pour obéir à des règles très précises, les nouveaux paradigmes de l’apprentissage profond ou de l’apprentissage par renforcement ont produit des machines capables de prouesses dont beaucoup auraient été sceptiques dans les années 2000 : apprendre, par elles-mêmes, le go et les échecs, générer des textes crédibles, ou conduire des voitures. Alors, l’intelligence artificielle est-elle (enfin) devenue intelligente ? Et si oui, à quoi doit-on s’attendre ?

L’apprentissage par renforcement, c’est quoi ?

Le précédent paradigme de l’IA consistait à programmer explicitement des machines pour répliquer des comportements humains identifiés comme efficaces. C’était le cas de Deep Blue, le programme développé par IBM ayant vaincu Garry Kasparov aux échecs en 1996, qui avait été spécifiquement codé par des joueurs experts pour appliquer parfaitement les meilleures techniques de jeu.

Au contraire, l’apprentissage par renforcement consiste à partir de zéro et laisser un programme informatique découvrir les meilleures stratégies et les comportements les plus efficaces, afin de maximiser un indicateur fixé par les développeurs (tel un score ou une probabilité de gagner en fin de partie). L’IA, incapable de jouer correctement au départ, progresse en tentant de nouvelles stratégies lors de milliers de parties jouées contre elle-même.

La popularité de l’apprentissage par renforcement a réellement décollé en 2015, avec AlphaGo, l’IA de DeepMind qui a battu le coréen Lee Sedol—un des meilleurs joueurs du monde.

L’intelligence artificielle peut-elle être plus qu’un champion du monde de Go ?

Les exemples les plus connus et les plus poussés de ces “nouvelles IAs” sont presque tous à mettre au crédit de deux laboratoires industriels. D’un côté, DeepMind, fondé à Cambridge et racheté par Google en 2014, qui s’est rendu célèbre avec plusieurs IAs : AlphaGo (qui a battu au jeu de go les meilleurs mondiaux en 2016–2017), AlphaZero (une version généralisée d’AlphaGo, capable d’apprendre à jouer aux échecs et au go sans aucune connaissance, si ce n’est celle des règles), et AlphaStar (une expérience similaire sur le jeu de stratégie StarCraft 2).

De l’autre, OpenAI, un laboratoire américain à but initialement non lucratif, qui s’est illustré par le développement d’OpenAI Five (une IA ayant battu les meilleurs équipes du monde au jeu Dota 2) et plus récemment de GPT-3 (un programme capable de comprendre et générer du texte), décrit par Wired comme “l'IA la plus impressionnante du monde”.

Si les résultats de ces expériences peuvent s’avérer troublants, il est encore compliqué d’appeler ces programmes informatiques des “intelligences”, eut égard à notre usage de ce mot pour l’intelligence humaine. Notamment parce qu’ils ont une très faible capacité à généraliser leurs connaissances à des situations inconnues mais similaires : AlphaGo serait par exemple incapable d’agir face à un plateau de Monopoly. Ces IAs sont ainsi qualifiées d’intelligences artificielles “étroites”, puisqu’elles ne récréent qu’une partie de l’intelligence humaine, limitant leurs interventions aux situations pour lesquelles elles ont été entraînées.

L’objectif de ces laboratoires est pourtant bien plus ambitieux que ces projets, et vise la création d’une IA dite “générale” : une machine capable d’apprendre de façon globale, et pouvant extrapoler ses connaissances et compétences d’un domaine à l’autre. Ces IAs générales (ou AGI, pour Artificial General Intelligence) seraient tout autant capable de jouer à des jeux vidéo que de tenir une conversation en polonais, de comprendre un concept philosophique, ou de résoudre des équations mathématiques.

En quête d’une intelligence artificielle générale

En 2018, les estimations de 18 experts interrogés sur la date à laquelle apparaîtraient ces AGIs, s'étalaient entre 2029 et 2200, avec une moyenne en 2099. Dans une étude similaire menée en 2019 auprès de 32 chercheurs, 45 % prédisaient l'arrivée d’une AGI avant 2060 et 34 % après 2060—là où 21 % considéraient qu’aucune AGI ne serait jamais créée. Ces estimations témoignent du degré d’incertitude quant à la faisabilité d’une AGI mais également quant aux conditions de sa création : des lignes de fracture nous permettant d’identifier trois grands paradigmes.

D’un côté les optimistes, soit la quasi-totalité des ingénieurs de laboratoires industriels comme OpenAI ou DeepMind, qui pensent que toutes les briques techniques nécessaires à la création d’une AGI ont d’ores-et-déjà été découvertes. Dans cette vision, les techniques utilisées aujourd’hui constituent les “acides aminés” de l’intelligence générale, et le défi actuel consiste uniquement à comprendre comment les améliorer et les agencer pour créer l’étincelle nécessaire à la naissance d’une véritable intelligence.

De l’autre les sceptiques, qui pensent que le paradigme actuel de l’apprentissage automatisé ne sera pas suffisant pour dépasser le stade d’un “ordinateur très efficace” et créer une intelligence digne de ce nom. Ce point de vue, soutenu par des chercheurs travaillant sur les éléments “fondamentaux” de l’intelligence (la logique, les représentations mentales, la créativité, l’adaptabilité), ne signifie pas qu’une AGI est impossible, mais que sa création est plus lointaine car nécessitant un changement complet du paradigme technique actuel.

Enfin, certains spécialistes—de plus en plus minoritaires—soutiennent qu’une intelligence artificielle ne sera jamais possible, car il lui manquera toujours des caractéristiques fondamentales de l’intelligence humaine.

Carbone & silicium, Mathieu Bablet, 2020

De l’AGI à la superintelligence ?

Si la communauté scientifique semble globalement s’accorder sur la faisabilité d’une AGI, l’inconnu réside plutôt dans ce qui passera après la création de celle-ci. Là où un être humain dispose des capacités à apprendre et progresser, ce potentiel est limité par des barrières physiques et temporelles empêchant, pour un individu unique, l'acquisition et l’utilisation de l’ensemble des connaissances humaines.

Au contraire, une AGI disposant d’une puissance de calcul lui permettant de “lire” la totalité de Wikipédia et d’apprendre l’informatique pour réécrire son propre code, améliorant ainsi son propre processus d’apprentissage, aurait tôt fait de laisser derrière elle son statut d’AGI pour devenir ce que le chercheur de l’université d’Oxford Nick Bostrom appelle une superintelligence : “un intellect beaucoup plus compétent que les meilleurs cerveaux humains dans pratiquement tous les domaines, y compris la créativité scientifique, la sagesse et les talents sociaux.”

Ici encore, le débat fait rage entre ceux convaincus d’un “décollage dur”, soit l’hypothèse que ce stade supérieur serait atteint quelques heures ou semaines après la création d’une AGI, et ceux convaincu d’un “décollage doux” s’étalant sur plusieurs années—laissant le temps à l’humanité de débattre de la marche à suivre pour accompagner le développement d’une intelligence qui la dépasse. Dépassement qui, selon Nick Bostrom, fait figure de scénario inévitable : “le train n’a pas pour destination la gare de l’intelligence humaine ; il va y passer momentanément sans marquer l’arrêt”.

Et ensuite ? Ensuite, de la prospective et des débats—que nous tâcherons de retranscrire dans notre prochain numéro, tout en essayant d’éviter les lieux communs propres à la littérature du genre.

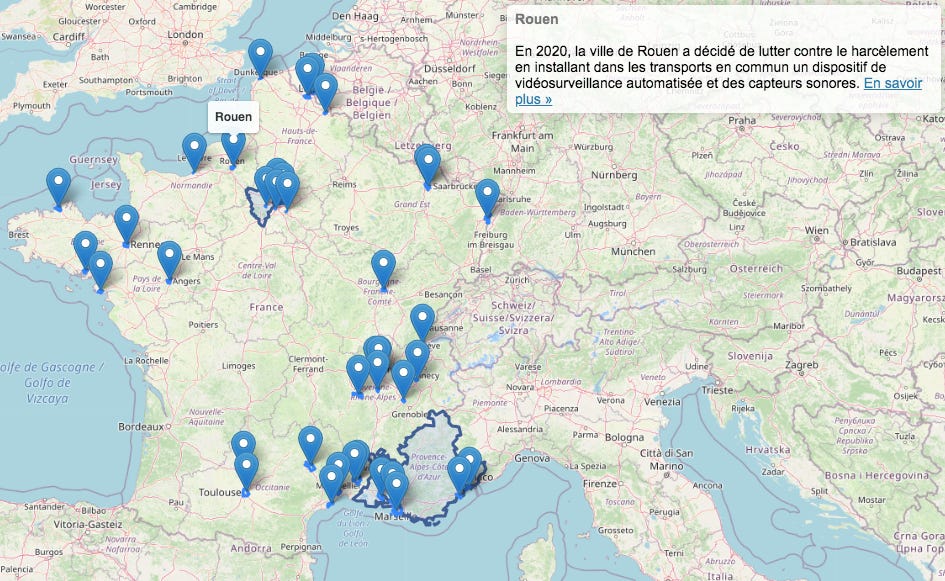

La cartographie de la semaine

La Quadrature du Net a lancé pendant l’été une initiative collaborative visant à cartographier et à décrire les différents projets de “technopolice” en France. Au-delà de la critique de ces dispositifs, le projet de l’association est d’illustrer la multiplication de ces initiatives et de mettre en lumière l’absence de débat et le manque de cadre juridique qui les accompagnent.

Protéiformes, ces initiatives recouvrent des portiques de reconnaissance faciale, des caméras de vidéosurveillance “intelligente”, des capteurs sonores ou encore le déploiement de drones.

Si le sujet vous intéresse, vous pouvez également écouter l’épisode de l’émission “Secrets d’infos” de France Inter dédiée à ce sujet : “La reconnaissance faciale se met en place à bas bruit”.

On a aimé

Au-delà des limites actuelles de l’IA, Vox.com liste les différentes raisons expliquant pourquoi nous sommes toujours si loin d’avoir des voitures totalement autonomes.

Les électeurs latinos, enjeu de la prochaine élection présidentielle américaine, seraient soumis à plus de publicités politiques que les autres.

Mais qu’en penser, si les publicités politiques n’ont finalement presque aucun effet sur les personnes exposées ?

Les traductions des rapports d’experts de Mark Feldstein, Noam Chomsky & Paul Rogers, amenés à intervenir en tant qu’experts au procès de Julian Assange.

Algorithmes racistes, le retour : l’algorithme “photo preview” de Twitter est accusé de favoriser les visages blancs au détriment des visages noirs.

Le rétropédalage de YouTube qui a décidé de remettre de l’humain dans ses dispositifs de modération des contenus après que les IAs se sont montrées trop rigoristes.

Le Signal et le Bruit est une newsletter bimensuelle dédiée à l’intelligence artificielle et aux données. Guillaume Jaeger et Edouard Mathieu en sont les auteurs. Tom Goyon en a réalisé le design.

Curieux de savoir si l'empathie peut être appris par une machine.